Ви просите ChatGPT знайти дослідження — він видає посилання, яких не існує. Запитуєте про людину — отримуєте впевнену біографію з вигаданими фактами. Просите перевірити дату — він підтверджує неправильну.

Це не баг і не збій. Це фундаментальна особливість того, як працюють великі мовні моделі. І якщо ви розумієте механіку — ви набагато краще контролюєте результат.

Чому це відбувається

ChatGPT — це не пошукова система і не база даних. Це модель, яка навчилася передбачати наступне слово в тексті на основі мільярдів прикладів. Вона не «знає» факти в тому сенсі, в якому знаєте їх ви — вона навчилася генерувати текст, який схожий на правдивий.

Коли ви ставите запитання, модель не йде шукати відповідь — вона будує найімовірнішу послідовність слів, яка відповідає контексту вашого запиту. Якщо в її навчальних даних не було точної відповіді, вона заповнює прогалини тим, що звучить правдоподібно.

Звідси і галюцинації: не тому що модель хоче вас обдурити, а тому що вона оптимізована на правдоподібність, а не на точність.

- Знання обмежені датою навчання. Якщо ви питаєте про свіжі події, модель може чесно сказати, що не знає, або згенерувати щось правдоподібне.

- Теми з малою кількістю даних. Про маловідомих людей, нішеві теми й локальні події в навчальних даних було менше інформації.

- Конкретні факти. Дати, цифри, посилання і точні назви — зона, де помилки трапляються особливо часто.

- Впевнений тон не означає правильну відповідь. Модель може звучати однаково переконливо і тоді, коли спирається на дані, і тоді, коли добудовує прогалини.

Де галюцинації трапляються найчастіше

Варто знати зони підвищеного ризику:

- Посилання і джерела — найнебезпечніша зона. Ніколи не вставляйте посилання з ChatGPT без перевірки.

- Біографії людей — особливо маловідомих. Дати, посади й досягнення можуть бути вигадані.

- Статистика і дослідження — цифри, відсотки, назви досліджень і конкретні висновки.

- Нещодавні події — усе, що відбулося після knowledge cutoff моделі.

- Локальна і нішева інформація — законодавство конкретної країни, місцеві компанії, регіональна специфіка.

Що з цим робити: практичні поради

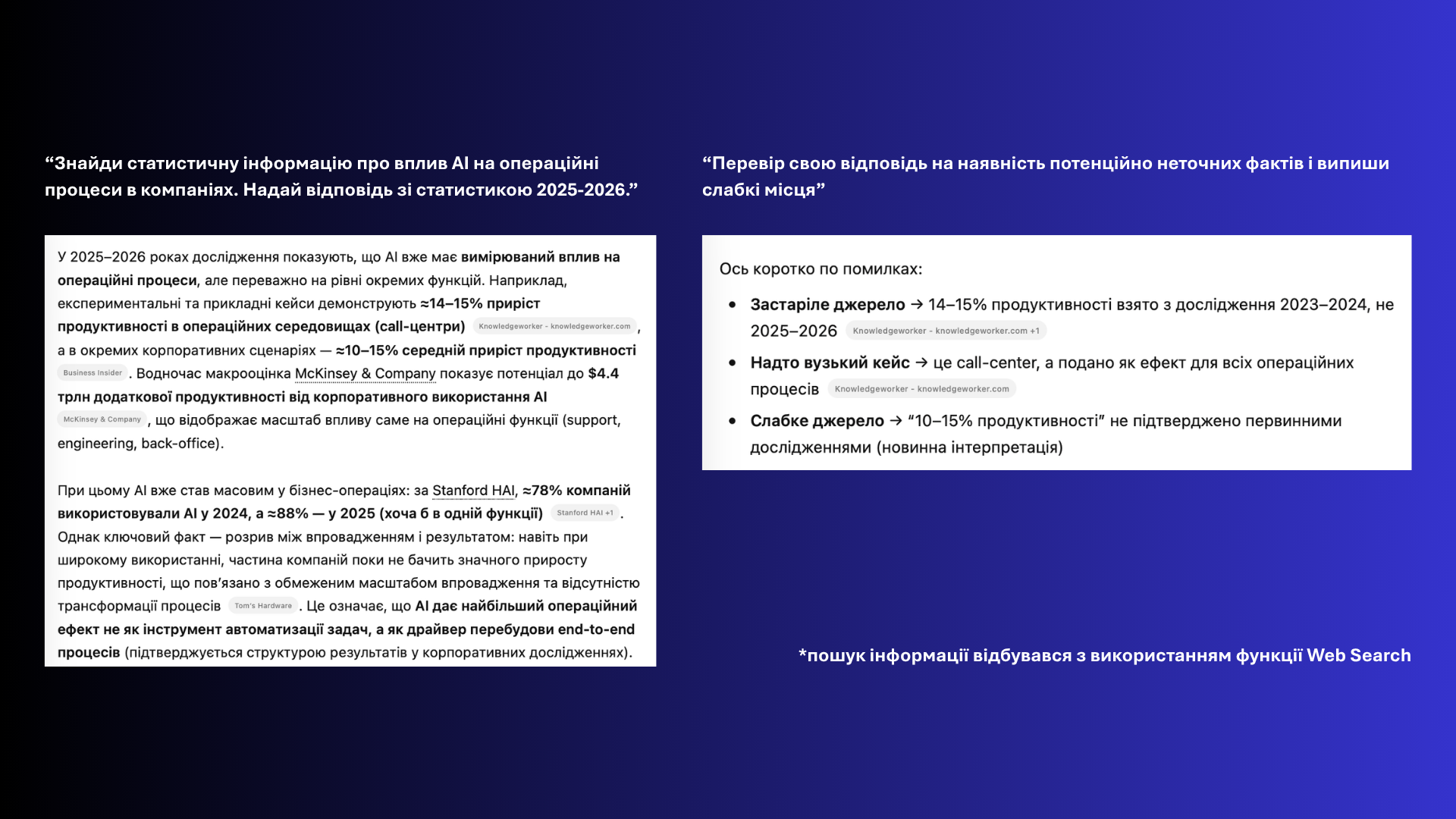

Вмикайте веб-пошук

Найпростіший спосіб зменшити галюцинації — дати моделі доступ до актуальної інформації. У ChatGPT є вбудований веб-пошук: якщо він активний, модель спирається на реальні джерела, а не тільки на навчальні дані. Переконайтеся, що пошук увімкнений, коли питаєте про факти, події, людей або статистику.

Просіть вказати джерела — і перевіряйте їх

Якщо ChatGPT дає конкретний факт, попросіть джерело: «Вкажи джерело для цієї статистики» або «Звідки ця інформація — є посилання?»

Але просто отримати посилання недостатньо. Обов'язково перевірте, що воно реальне і веде на той матеріал, про який йдеться.

Формулюйте запити так, щоб залишати місце для «не знаю»

ChatGPT рідко сам визнає невпевненість, але його можна до цього спонукати:

Якщо ти не впевнений у точності — скажи про це.

Відповідай тільки на основі того, що точно знаєш, не здогадуйся.

Якщо не маєш достатньо інформації — краще скажи, що не знаєш, ніж вигадуй.

Розділяйте задачі на ті, де потрібна точність, і ті, де ні

Галюцинації критичні, коли ви просите факти, дати, джерела, юридичну або медичну інформацію. Але вони майже не мають значення, коли ви просите ChatGPT перефразувати текст, згенерувати ідеї, написати шаблон листа або пояснити концепцію своїми словами.

Перевіряйте факти зовнішніми інструментами

Для фактчекінгу AI-відповідей добре підходять:

- Claude — частіше визнає невпевненість і прямо каже, коли не знає відповіді.

- Perplexity AI — дає відповіді з посиланнями на реальні джерела, які можна одразу перевірити.

- Google — простий і надійний спосіб перевірки конкретних тверджень.

- Wikipedia — підходить для базової перевірки дат, імен і подій.

Просіть ChatGPT перевірити себе

Можна попросити модель критично переглянути власну відповідь:

Перевір свою відповідь на наявність потенційно неточних фактів.

Які твердження у цьому тексті варто перевірити додатково?

Що з цього ти знаєш точно, а що може бути неточним?

Це не ідеальний метод, але іноді модель сама вказує на слабкі місця у своїй відповіді.

Головне правило

ChatGPT — потужний інструмент для генерації, структурування і пояснення. Але він поганий фактчекер самого себе. Будь-яка конкретна фактична інформація — дати, цифри, імена, посилання, дослідження — потребує незалежної перевірки перед використанням.

Ставтеся до ChatGPT як до дуже розумного колеги, який іноді впевнено говорить речі, яких не знає. Корисний — але довіряй, та перевіряй.

Цей матеріал створено у співпраці з AI і відредаговано командою. Ми віримо, що майбутнє контенту — саме за таким підходом.

Хочеш навчитися працювати з AI-інструментами впевненіше?

Практичні воркшопи з AI-інструментами для контенту, дизайну та брендингу — безкоштовно.

До AI Design Studio →